📒 学霸笔记:03|群雄并起:扫描命令行 AI Agent 生态,我们为何聚焦 Claude Code?

Top Student Notes: 03 | Rising Powers: Scanning the CLI AI Agent Ecosystem — Why Focus on Claude Code?

课程 / Course: AI 原生开发工作流实战 / AI-Native Development Workflow in Practice

讲师 / Instructor: Tony Bai

章节 / Chapter: 03

主题 / Topic: 命令行 AI Agent 生态全景 + Claude Code 选型逻辑

一、这讲在解决什么问题?

What Problem Does This Lecture Solve?

上一讲我们已经知道:

- AI 原生开发的核心方法论是 规范驱动开发(SDD)

- 开发者角色正在向:

- 规范设计师

- 工作流指挥家

- 质量治理者

演进

但方法论要落地,必须有一个合适的执行载体。

所以本讲回答 3 个关键问题:

- 为什么命令行 AI Agent 是 AI 原生开发的最佳载体?

- 当前主流 CLI Agent 有哪些?它们分别擅长什么?

- 为什么本专栏最终选择 Claude Code 作为核心实战工具?

二、核心结论先看

Key Takeaways First

一句话总结

AI 原生开发需要的不是“会聊天的 AI”,而是“能进入工作流、理解环境、执行动作、可被自动化集成的 CLI 智能体”。

本讲最终结论

Claude Code 不是唯一的 CLI Agent,但它是当前最适合系统学习 AI 原生工作流的方法论载体。

三、为什么是命令行 AI Agent,而不是 Web UI 或 IDE AI?

Why CLI AI Agents Instead of Web UI or IDE AI?

Tony 给出的核心判断是:

关键差异在于:执行深度(Execution Depth) + 集成自由度(Integration Freedom)

1. Web UI 的局限

Limitations of Web UI

例如:

- ChatGPT Web

- Gemini Web

- Claude Web

优点

- 使用门槛低

- 适合问答、解释、头脑风暴

- 适合快速获取知识

局限

- 无法真正进入你的工程环境

- 无法稳定读写本地项目

- 无法自然接入 shell / git / CI

- 更像“远程顾问”,不是“执行代理”

学霸理解

Web UI 适合 认知增强,不适合 工作流自动化。

2. IDE 插件 / AI 原生 IDE 的局限

Limitations of IDE Plugins / AI-Native IDEs

例如:

- GitHub Copilot Chat

- Cursor

- JetBrains AI Assistant

相比 Web UI 的进步

- 能看到当前文件和工作区

- 能上下文感知

- 能辅助写代码、解释代码、改代码

- 某些工具能调用内置终端

但根本问题仍然存在

Tony 反复强调的关键点:

它们的行动能力仍被绑定在 IDE 运行的本地开发环境里。

这意味着它们难以天然成为:

- 服务器上的执行代理

- CI/CD 中的自动化代理

- Docker 容器里的数字员工

- 可嵌入脚本/Makefile/Git Hooks 的原子能力

学霸理解

IDE AI 很强,但本质仍偏向 局部增强型工具,而不是 环境无关的工作流执行体。

3. CLI Agent 的决定性优势

Decisive Advantages of CLI Agents

命令行 AI Agent 的本质:

它与开发者共享同一个终端宇宙(Terminal Universe)

在终端里:

- 一切皆文件

- 一切皆命令

- 一切都可自动化

因此它拥有 3 个决定性优势:

① 完全的环境感知

可以像开发者一样使用:

lstreefindgitcatgrepmake

来理解项目全貌。

② 无限制的行动能力

在授权前提下,它可以:

- 读写文件

- 跑测试

- 执行构建

- 调用脚本

- 访问仓库

- 参与部署流程

③ 天然可编程、可集成

它本身就是 CLI 程序,因此可以轻松接入:

- shell script

- Makefile

- Git hooks

- CI/CD pipeline

- Docker

- remote runner

4. 本质结论

Essential Conclusion

CLI Agent 是第一个真正能被纳入软件工程流水线的 AI 形态。

这也是为什么它最适合承载:

- SDD

- 自动化开发流

- 多阶段编译式工程流程

- L3/L4 AI 原生开发

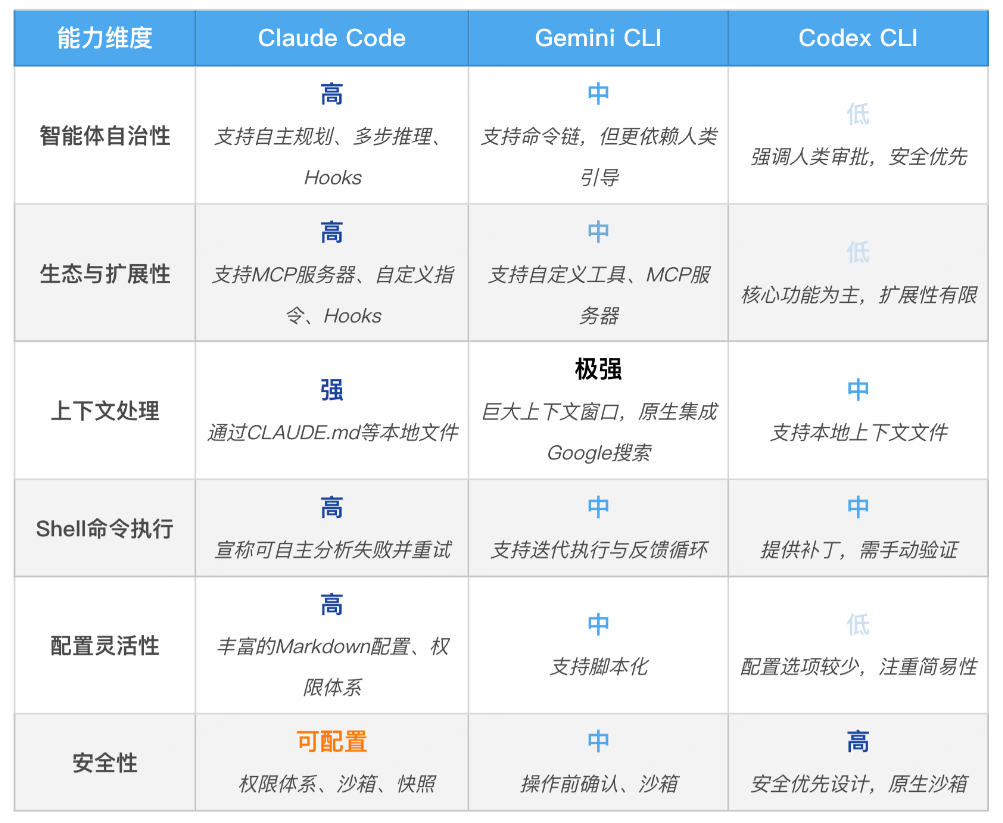

四、三大主流 CLI Agent:Claude / Gemini / Codex

The Three Mainstream CLI Agents

Tony 将当前主流 CLI Agent 生态概括为“三国演义”:

- Claude Code

- Gemini CLI

- Codex CLI

注意:这里不比较底层模型“谁更聪明”,而是比较:

作为开发者,使用它们做真实工程任务时,交互体验、能力边界和设计哲学有何不同。

五、第一层差异:生态准入成本

First Layer Difference: Ecosystem Entry Cost

虽然三者安装通常都可以:

npm install ...

但真正的差异不在安装命令,而在 生态准入门槛。

1. Claude Code

特点

- 安装流程相对直接

- 通过 Anthropic 账户授权

- 商业化定位清晰

成本点

- 需要付费账户 / 商业订阅

2. Gemini CLI

特点

- 工具本身免费,额度相对慷慨

- 与 Google 账号体系深度绑定

成本点

- 有时需要 GCP 项目配置

- 企业账号场景下配置成本可能更高

3. Codex CLI

特点

- 依赖 OpenAI 账号体系

成本点

- 社区反馈可能有更高等级的账户验证要求

- 某些用户上手会遇到身份验证成本

学霸理解

CLI 工具的安装本身不是门槛,真正的门槛是:

- 账号体系

- API / Billing / Cloud 配置

- 安全验证

- 企业接入复杂度

六、第二层差异:三者的设计哲学

Second Layer Difference: Their Design Philosophies

这是本讲最重要的部分之一。

Tony 并不是说谁“更强”,而是说:

三者从一开始就不是按同一种产品哲学设计出来的。

1. Claude Code:为“自治”而生的工作流引擎

Claude Code: A Workflow Engine Built for Autonomy

核心哲学

Agentic Autonomy(智能体自治)

目标定位

不是简单问答工具,而是:

- 深刻理解项目上下文

- 自主规划任务

- 执行复杂工作流

- 能集成、能重试、能扩展

体现在哪些能力上?

- Hooks

- 项目导航能力

- Git 集成

- 上下文管理(如

CLAUDE.md) - 更强的多步执行能力

适合的角色

像一个“虚拟团队成员”或“工作流引擎”

2. Gemini CLI:对话式上下文引擎

Gemini CLI: A Conversational Context Engine

核心哲学

大上下文 + 富交互 + 外部知识联动

目标定位

- 更像一个“超级大脑”

- 擅长处理海量上下文

- 擅长结合 Google 搜索/外部资料

- 擅长大规模理解、重构、文档消化

强项场景

- 跨大量文件做理解

- 需要外部文档辅助的任务

- 仓库级重构建议

- 大规模背景材料消化

适合的角色

像一个“研究助理”或“上下文专家”

3. Codex CLI:安全第一的精准编辑助手

Codex CLI: A Safety-First Precision Editing Assistant

核心哲学

安全、清晰、可控

目标定位

- 强调 patch-based / diff-based 修改

- 每次变更尽量清晰呈现

- 强调人在回路中的确认

- 通过沙箱机制提升安全性

强项场景

- 精准补丁生成

- 安全可控地修改代码

- 你希望每一步都看得很清楚

- 你不需要它“自主发挥太多”

适合的角色

像一个“外科医生”或“精准编辑助手”

七、三者的人设总结

Persona Summary of the Three

| 工具 | 核心人设 | 关键词 |

|---|---|---|

| Claude Code | 工作流引擎 | 自治、规划、扩展、工作流 |

| Gemini CLI | 上下文专家 | 大上下文、搜索、对话、理解 |

| Codex CLI | 安全助手 | 可控、补丁、沙箱、精确 |

八、适用场景对比

Use-Case Comparison

Claude Code 更适合

- 项目级重构

- 多步骤调试

- 自动化工作流

- 自主处理复杂任务链

- 与 hooks / MCP / 脚本生态集成

- 在规范和流程约束下长期工作

典型任务

- “根据

CLAUDE.md重构整个模块” - “跑测试、定位失败、修复后重新验证”

- “在项目规范下完成端到端功能实现”

Gemini CLI 更适合

- 大规模上下文理解

- 依赖外部知识的开发任务

- 基于长文档/大量源码的综合分析

- 仓库级阅读和总结

典型任务

- “读完整个仓库并总结架构”

- “参考外部 API 文档帮我生成 SDK 调用层”

- “跨多个模块进行大规模命名调整建议”

Codex CLI 更适合

- 精准代码修改

- 小到中等规模 patch 生成

- 你强烈要求安全和逐步确认

- 你不希望 Agent 拥有太多自主权

典型任务

- “只修这个 bug,不要碰别的”

- “给我一个清晰 diff,我审批后再改”

- “严格限制变更范围的补丁编辑”

九、为什么专栏最终聚焦 Claude Code?

Why the Course Ultimately Focuses on Claude Code

这是全讲结论的核心。

Tony 给出 4 个战略理由。

理由 1:为了学习最完整的方法论

Reason 1: To Learn the Most Complete Methodology

课程目的不是学某个按钮怎么点,而是学:

- AI 原生工作流

- 上下文管理

- 规范驱动执行

- 安全控制

- 能力扩展

- 自主规划

Claude Code 是目前最完整承载这整套方法论的工具。

学霸理解

学 Claude Code,不是只学一个产品,而是在学一整套 AI 原生工程语言。

理由 2:为了掌握“事实标准”的缔造者

Reason 2: To Learn the Creator of the De Facto Standard

Claude Code 是 CLI Coding Agent 领域的重要开创者。

很多今天常见的交互范式,如:

@注入上下文!执行 shell/Slash Commands

最早就是由 Claude Code 一类工具系统化推广开的。

学霸理解

学它,相当于在学这个领域的“源语言”和“原始设计哲学”。

理由 3:为了触及最高能力天花板

Reason 3: To Reach the Highest Capability Ceiling

Claude Code 的一些高级特性代表了当前行业高水位:

- Sub-agent

- Hooks

- Checkpointing

- 更强的自治执行模式

- 更适合复杂自动化系统

这些能力决定了它更像:

生产级引擎,而不仅是增强型助手

理由 4:为了拥抱最繁荣的生态核心

Reason 4: To Embrace the Richest Ecosystem Core

因为先发优势和使用广泛:

- 社区实践多

- 第三方生态活跃

- 文档和经验丰富

- 模型接入支持也更完善

甚至很多模型厂商会专门适配 Claude Code 的客户端生态。

学霸理解

掌握 Claude Code,相当于站在当前 CLI AI 工程生态的中心点。

十、现实问题:Claude Code 很强,但也“很吃 Token”

The Real Issue: Claude Code Is Powerful, but Hungry for Tokens

Tony 很坦诚地指出:

这类强工具普遍 “Hungry for Tokens”

原因是:

- 需要读取大量上下文

- 要做更复杂规划

- 要跑更多轮推理

- 要执行更多环境交互

所以成本问题必须正视。

十一、解决方案:客户端与“大脑”分离

The Solution: Separate the Client from the “Brain”

这是非常实用的一点。

核心思路

保留 Claude Code 的客户端工作流能力,但将其接到更便宜、更稳定的模型服务上。

例如:

- 国内兼容 Anthropic API 的模型服务

- 如文中提到的智谱 AI 等

为什么可行?

因为可以把系统拆成两部分:

1. 客户端(工作流层)

Claude Code CLI 负责:

- 文件交互

- 上下文管理

- 命令编排

- 工具调用

- 工作流组织

2. 模型(推理层)

后端大模型负责:

- 语言理解

- 推理

- 代码生成

- 决策输出

这个方案的价值

好处

- 依然能学习 Claude Code 的工作流方法论

- 成本更低

- 访问更稳定

- 国内开发者更容易实践

Trade-off

- 生成质量可能和官方顶级模型有差距

但课程目标不受影响

因为课程核心学的是:

- 方法论

- 工作流设计

- 人机协作模式

- CLI Agent 的工程使用方式

而不是“只学某个底模最强能力”。

十二、本讲最重要的逻辑链

The Most Important Logic Chain in This Lecture

AI 原生开发

→ 需要工作流级执行能力

→ Web/IDE 形态不够自由

→ CLI Agent 才能真正进入工程流水线

→ CLI Agent 中三家各有哲学

→ 课程要选最能承载完整方法论的工具

→ Claude Code 最适合作为教学主载体

十三、与前两讲的知识衔接

Connection to the Previous Two Lectures

和第 01 讲的关系

第 01 讲讲的是:

- L1 / L2 / L3 / L4 成熟度模型

- 本专栏定位:精通 L3,触及 L4

这讲就是在回答:

L3 阶段的最佳执行载体是什么?

答案:

命令行 AI Agent

和第 02 讲的关系

第 02 讲讲的是:

- SDD:

spec.md → plan.md → tasks.md - Spec → Generate → Validate

这一讲则补上了:

谁来执行这套规范驱动流程?

答案:

CLI Agent,尤其是 Claude Code 这种工作流引擎型 Agent

十四、学霸速记表

Quick Memorization Table

| 问题 | 结论 |

|---|---|

| 为什么不是 Web UI? | 只能问答,难以进入真实工程环境 |

| 为什么不是 IDE AI? | 行动能力受 IDE 本地环境绑定 |

| CLI Agent 最大优势? | 环境感知 + 动作执行 + 自动化集成 |

| Claude Code 哲学? | 自治工作流引擎 |

| Gemini CLI 哲学? | 对话式上下文引擎 |

| Codex CLI 哲学? | 安全第一的精准编辑助手 |

| 课程为何聚焦 Claude Code? | 方法论最完整、事实标准、能力上限高、生态最强 |

| Claude Code 的现实问题? | 成本高、吃 Token |

| 可行解决方案? | 保留客户端,切换更低成本模型服务 |

十五、学霸自检题

Self-Check Questions

基础题

- 为什么命令行 AI Agent 比 Web UI 更适合 AI 原生开发?

- Claude Code、Gemini CLI、Codex CLI 的核心定位分别是什么?

- 什么叫“执行深度”和“集成自由度”?

进阶题

- 为什么说 IDE Agent 仍然存在“环境绑定”问题?

- Claude Code 为什么更适合作为“方法论学习工具”而不是单纯“能力最强工具”?

- 为什么“客户端 + 国内模型”方案不影响课程的核心学习目标?

思辨题

- 如果你团队现在只能选一个 CLI Agent,你更看重:

- 自主工作流能力

- 大上下文理解

- 安全可控修改

你会选谁?为什么?

- 你现在的工程环境更适合哪种 Agent:工作流引擎、上下文专家,还是安全助手?

十六、学霸总结

Top-Student Summary

这讲的核心不是单纯做一个“工具排行榜”,而是做一次方法论载体的战略选型。

Tony 先论证了:真正的 AI 原生开发需要的是 CLI Agent,因为只有它具备足够的执行深度和集成自由度,能够真正进入开发、测试、构建、部署的工作流之中。

然后,他比较了三大主流工具的设计哲学:

- Claude Code:自治型工作流引擎

- Gemini CLI:上下文理解型专家

- Codex CLI:安全可控型编辑助手

三者并非谁“绝对更强”,而是分别适合不同任务类型。

而本专栏选择 Claude Code,并不是因为它“唯一最好”,而是因为它最完整地承载了 AI 原生开发的方法论:上下文管理、规范驱动、安全控制、扩展机制、自主规划和自动化集成。它更像这个领域的“事实标准”和“范式源头”。

最后,针对 Claude Code 成本高的问题,Tony 提出了一个很实用的思路:保留 Claude Code 的客户端工作流能力,把后端模型切换到更低成本、兼容的模型服务。这样既能学到完整方法论,也能降低实践门槛。

十七、一句话记忆

One-Sentence Memory Hook

选择 Claude Code,不只是选择一个工具,而是选择当前最完整的 AI 原生开发工作流范式。